Índice

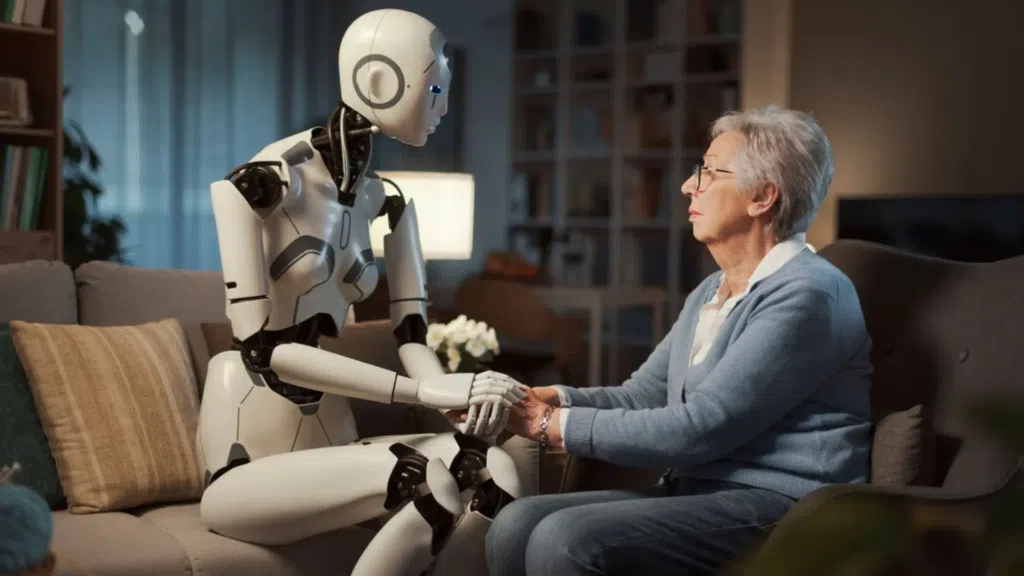

Fotos e vídeos gerados com IAs (Inteligências Artificiais) são o assunto em toda a internet há algum tempo. Seja para criar um avatar ou um vídeo de data especial, essas criações estão bastante presentes no cotidiano online, mas muitas vezes são confundidas com imagens reais, podendo levar à disseminação de notícias falsas — as fake news. Um dos públicos mais atingidos pertence à faixa etária acima de 50 anos, em especial os idosos, e um dos lugares que mais contém imagens enganosas geradas por IA é o Facebook. Confira alguns dados de estudos publicados sobre o assunto.

Dados da pesquisa

O conteúdo gerado por inteligência artificial vem se tornando cada vez mais popular, principalmente nas redes sociais, sendo cada vez mais comuns imagens que se enquadram no vale da estranheza — ou uncanny valley. Este conceito denomina imagens que parecem reais, mas possuem elementos artificiais que causam desconforto a quem as vê. Ainda que haja uma elevada semelhança com humanos reais, imagens no vale da estranheza possuem uma característica artificial, ainda que se assemelhem muito ao natural. Essa percepção, ao que tudo indica, está relacionada às pessoas mais jovens.

Já as pessoas mais velhas têm dificuldade em identificar estes elementos estranhos, não naturais, nas mídias geradas por inteligência artificial, sendo mais propensos a serem enganados. A arte produzida por IA não é tão óbvia para todos, e a pesquisa aponta que pessoas acima de 50 anos estão caindo em massa nesses truques visuais nas redes sociais.

Plataformas como o Facebook têm se tornado cada vez mais populares entre pessoas mais velhas e idosos em busca de entretenimento e companhia, à medida que os usuários mais jovens migraram para aplicativos mais atuais, como o Instagram ou TikTok. Aparentemente, o algoritmo do Facebook tem direcionado intencionalmente imagens geradas por IA para os feeds dos usuários, com o objetivo de vender produtos e atrair seguidores, conforme um artigo feito por pesquisadores da Universidade de Stanford e da Universidade de Georgetown.

Os cientistas ainda não possuem respostas definitivas sobre os impactos psicológicos da arte gerada por inteligência artificial, uma vez que geradores de imagens se tornaram públicos há pouco tempo, cerca de dois anos. Mas compreender por que amigos e parentes mais velhos podem se sentir confusos, pode fornecer pistas importantes para ajudar a evitar que se tornem vítimas de fraudes ou desinformação.

Entender como esse cenário acontece é importante, porque empresas de tecnologia como o Google, tendem a ignorar os usuários mais velhos durante os testes internos, de acordo com Björn Herrmann, neurocientista cognitivo da Universidade de Toronto que estuda o impacto do envelhecimento na comunicação.

Mesmo que o processo de envelhecimento — principalmente o cognitivo — possa parecer a explicação mais óbvia para esta incompatibilidade com a tecnologia atual, as primeiras pesquisas sugerem que a falta de experiência e familiaridade com a IA poderia ajudar a explicar a compreensão entre o público mais jovem e o mais velho. A pesquisa, realizada por quase 1.300 adultos norte-americanos com 50 anos ou mais, aponta que apenas 17% dos participantes afirmaram ter lido ou ouvido sobre IA.

Até agora, as poucas experiências para analisar a percepção da IA de pessoas mais velhas parecem estar próximas com o que acontece no Facebook. Num estudo publicado recentemente na revista Scientific Reports, os cientistas mostraram a 201 participantes uma mistura de imagens geradas por IA e por seres humanos e avaliaram as suas respostas com base em fatores como idade, gênero e atitudes em relação à tecnologia. A equipe descobriu que os participantes mais velhos eram mais propensos a acreditar que as imagens geradas por IA foram feitas por humanos.

Embora o estudo sobre a percepção das pessoas em relação ao conteúdo gerado por IA seja limitado, os pesquisadores têm encontrado resultados semelhantes com áudio produzido por IA. No ano passado, Herrmann relatou que os indivíduos mais velhos tinham uma menor capacidade de discernir entre a fala gerada por humanos e a fala gerada por IA em comparação com os indivíduos mais jovens.

De maneira geral, Simone Grassini, psicóloga da Universidade de Bergen na Noruega, acredita que qualquer tipo de mídia gerada por IA pode enganar mais facilmente os espectadores mais velhos devido a um “efeito geral” mais amplo. Tanto Herrmann quanto Grassini sugerem que as gerações mais velhas podem não ter aprendido sobre as características do conteúdo gerado por IA e encontrá-lo menos frequentemente em suas vidas diárias, tornando-os mais vulneráveis quando esse conteúdo aparece em suas telas.

A redução na capacidade cognitiva e a perda auditiva (no caso do áudio gerado por IA) podem ter a sua influência, mas Grassini ainda observou que este efeito também aconteceu em pessoas entre os quarenta e os cinquenta anos. Os jovens cresceram na era da desinformação online e estão acostumados com fotos e vídeos adulterados, acrescentou Grassini.

Como se proteger de imagens falsas geradas por IA

A rápida evolução da inteligência artificial com certeza traz muitos benefícios à sociedade, mas como visto neste conteúdo, devemos ficar de olho nas consequências que essa tecnologia pode nos causar. Embora suas potencialidades sejam vastas, abrangendo áreas como saúde e educação, não se pode ignorar as possíveis desvantagens. Haywood Talcove, CEO de uma organização de segurança cibernética, adverte os mais velhos sobre o uso crescente da IA em esquemas de fraude romântica, tentativas de golpes de resgate e fraudes fiscais contra o governo.

Talcove declarou que há uma grande quantidade de pessoas dedicadas a desenvolver essa tecnologia para o bem, trabalhando incansavelmente. Por outro lado, há também um grupo igualmente dedicado a aplicar suas habilidades no lado negativo, empregando a IA para aprimorar suas artimanhas e explorar pessoas mais velhas e idosos. Pensando nisso, trouxemos aqui alguns pontos para poder se proteger e também proteger aquelas pessoas que precisam dessas orientações:

- Golpes românticos: Com os avanços da inteligência artificial, golpistas agora podem criar imagens visuais que parecem extremamente reais. Eles também têm a capacidade de gerar uma voz projetada para atrair uma vítima específica. Essas imagens e vozes realistas são usadas para persuadir a vítima a participar de encontros por vídeo. Aqui a dica é sempre confirmar a veracidade da foto ou vídeo, comparando com outras mídias da própria pessoa ou até mesmo realizando chamadas ao vivo;

- Resgate falso: Em muitas plataformas de mídia social, as pessoas têm vídeos curtos onde suas vozes são gravadas. Um fraudador pode usar uma dessas gravações para criar uma duplicata extremamente realista da voz da pessoa. Dessa forma, o golpista pode imitar a voz de um filho, neto ou outro membro da família para conduzir uma conversa. Durante a conversa, faça perguntas específicas e tente confirmar a identidade de quem está na ligação. Às vezes somente a voz não é indicativo de que aquela é a pessoa quem diz ser;

- Pense antes de clicar: O velho truque de clicar em links também pode estar associado às inteligências artificiais. É importante ter cautela ao abrir links, seja por e-mail ou mensagem de texto. Se o remetente não é reconhecido, evite clicar no link. Lembre-se de que nossos smartphones também são computadores. Um único clique em um link suspeito pode resultar no download de malware em seu dispositivo.

- Confie em sua intuição: A inteligência artificial pode criar mensagens que parecem vir de conhecidos, usando informações disponíveis publicamente. Isso aumenta o risco de cair em golpes. Desconfie de e-mails não solicitados e mensagens que pedem informações pessoais, mesmo que pareçam legítimos. Confie em sua intuição ao notar qualquer sinal de alerta, como erros de ortografia, formatação estranha ou repetitiva. Em caso de dúvida, entre em contato diretamente com a empresa ou pessoa através de um telefone, não por e-mail, para confirmar a autenticidade;

- Mantenha seu software atualizado: A inteligência artificial também pode identificar dispositivos vulneráveis, verificando versões de software ou falhas de segurança. Para manter seus dispositivos seguros, mantenha sempre seu aparelho (smartphone, notebook, tablet e etc), software e aplicativos atualizados. Isso ajuda a proteger contra possíveis explorações por malware.

Como proteger os mais velhos

Apesar dos desafios em identificar conteúdos falsos (fake news) à medida em que eles se proliferam online, os idosos geralmente têm uma visão diferente em relação ao quadro geral. Na verdade, eles podem ser mais propensos a reconhecer os perigos dos conteúdos gerados por IA do que as gerações mais jovens.

Uma pesquisa da MITRE-Harris Poll, envolvendo mais de 2.000 pessoas, indicou que uma parcela maior dos Baby Boomers (nascidos em 1946 e 1964) e Geração X (1965 até 1980) se preocupa com as consequências dos deepfakes — efeitos e edições em fotos e vídeos bastante difíceis de discernir — em comparação com os participantes da Geração Z (1997 até 2012) e da Geração Y (conhecidos também como millenials, nascidos entre 1981 e 1996).

Os grupos etários mais velhos apresentaram uma proporção maior de participantes que defendiam a regulamentação da tecnologia de IA e um maior investimento da indústria tecnológica para proteger o público. A pesquisa também revelou que os adultos mais velhos conseguem distinguir com maior precisão entre manchetes e histórias falsas em comparação com os adultos mais jovens, ou pelo menos identificá-las em taxas semelhantes.

Os adultos mais velhos também tendem a consumir mais notícias do que seus pares mais jovens e podem ter acumulado um amplo conhecimento sobre assuntos específicos ao longo da vida, o que torna mais difícil enganá-los.

Os golpistas têm se utilizado de ferramentas generativas de IA cada vez mais sofisticadas para visar os adultos mais velhos. Eles podem empregar áudios e imagens deepfake extraídos das redes sociais para simular um familiar ligando e pedindo dinheiro, ou mesmo falsificar a aparência de um parente em uma videochamada.

Vídeos, áudios e imagens falsificados também podem influenciar os eleitores mais velhos antes das eleições. Isso pode ser ainda mais prejudicial, uma vez que pessoas na faixa dos cinquenta anos ou mais tendem a compor a maioria dos eleitores em países como o próprio Brasil.

Para auxiliar os idosos em suas vidas, Hickerson destacou a importância de divulgar informações sobre a IA generativa e os riscos que ela pode representar online. Uma forma de começar a educá-los é evidenciando características dessas imagens que são claramente falsas, como texturas excessivamente suaves, dentes com aparência estranha, ou padrões que se repetem perfeitamente nos fundos das fotos.

Ela acrescenta que também podemos esclarecer o que sabemos e o que não sabemos sobre os algoritmos das redes sociais e como eles afetam o grupo de pessoas idosas. Também faz parte lembrar que a desinformação pode vir até mesmo de amigos e familiares.

Com o avanço das deepfakes e outras criações de IA a cada dia, até mesmo os especialistas em tecnologia mais experientes podem encontrar dificuldades em identificá-las. Mesmo se você se considera bastante entendido, esses modelos podem ser desconcertantes. O site This Person Does Not Exist, por exemplo, oferece fotos incrivelmente convincentes de rostos falsos criados por IA, muitas vezes sem sinais evidentes de suas origens computacionais.

Apesar de pesquisadores e empresas de tecnologia terem desenvolvido algoritmos para detectar automaticamente mídias falsas, eles não são infalíveis, e os modelos de IA generativa em constante evolução tendem a superá-los. Uma das IAs mais famosas em geração de imagem, o Midjourney, enfrentou desafios por um longo período para criar mãos realistas, antes de finalmente alcançar sucesso com uma nova versão lançada há alguns meses. Para enfrentar a crescente onda de conteúdos falsos imperceptíveis e suas consequências sociais, Hickerson enfatizou a importância da regulamentação e da responsabilidade corporativa.

Saiba mais sobre esta e outras notícias no Showmetech TRIO, o seu trio semanal de notícias de tecnologia:

E você, o que acha dessa onda de desinformação gerada por IA? Já caiu em alguma situação semelhante? Conta pra gente nos comentários!

Veja também:

Turistas já poderão viajar de balão para o espaço em 2025.

Com informações de: The Daily Beast, NORC, NCBI e American Legion

Revisado por Glauco Vital em 26/3/24.