Índice

Nesta segunda-feira, dia 18, a NVIDIA conduziu sua tão aguardada apresentação do GTC 2024 (GPU Technology Conference), aclamado pela empresa como “a principal conferência de IA para desenvolvedores”. Este evento anual é um ponto de encontro para especialistas, pesquisadores, desenvolvedores e aficionados, todos unidos para explorar e debater as mais recentes tendências e inovações em computação de alto desempenho, inteligência artificial, aprendizado de máquina, jogos e uma ampla gama de outras áreas.

Durante o evento deste ano, a empresa revelou sua mais recente arquitetura, a Blackwell, dedicada ao avanço da inteligência artificial. Além disso, apresentou seu novo supercomputador, o DGX SuperPOD, novidades sobre a Omniverse Cloud, juntamente com outros impressionantes anúncios. Confira a seguir os anúncios da NVIDIA na GTC 2024.

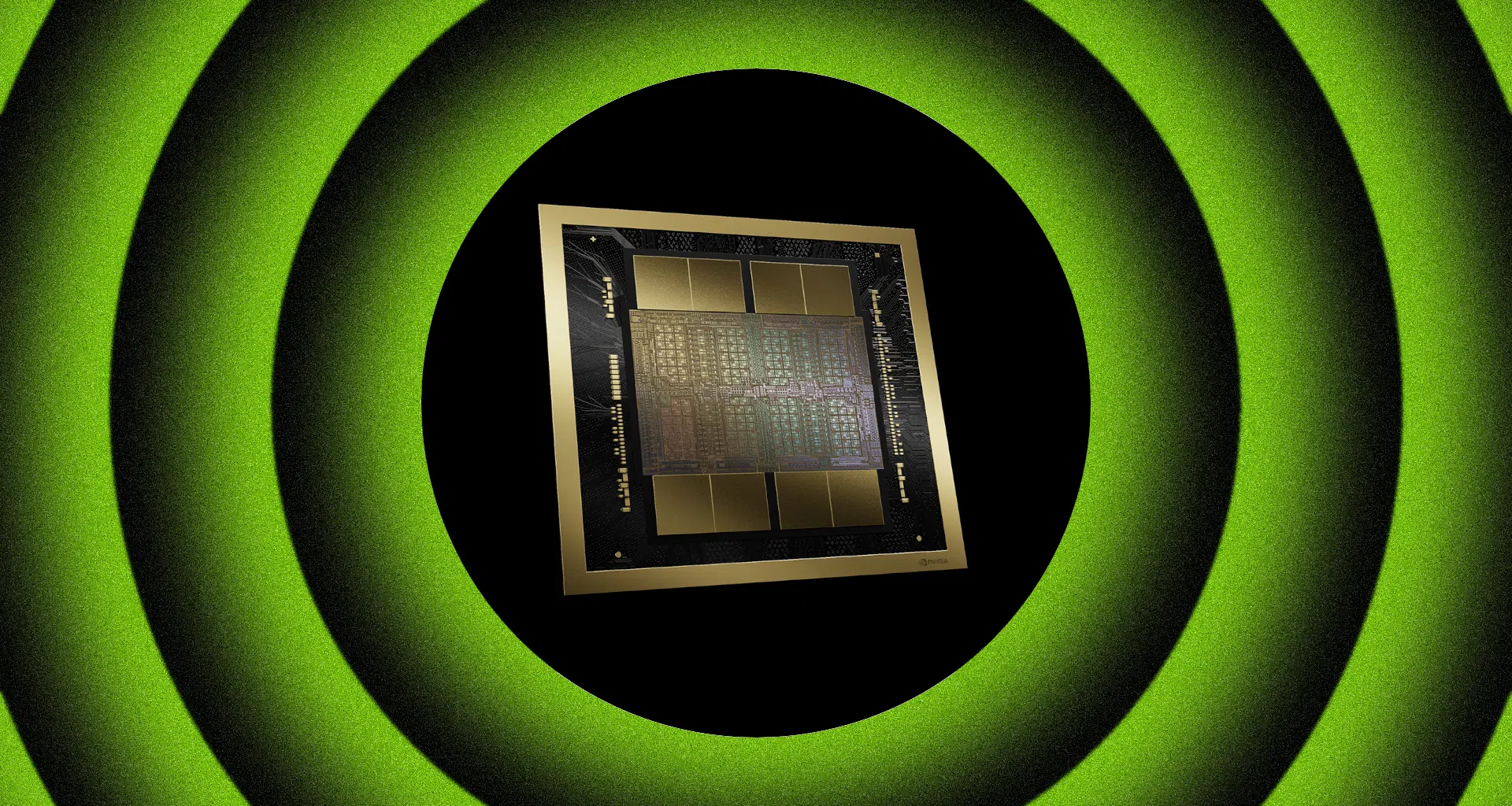

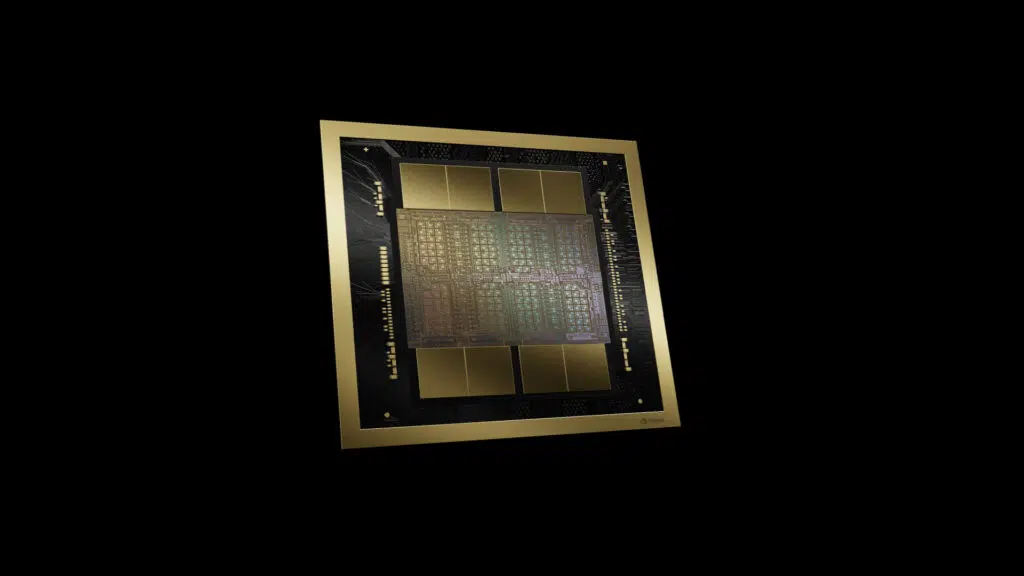

Nova arquitetura Blackwell da NVIDIA

O Blackwell é a nova arquitetura de GPU inovadora da NVIDIA que promete definir uma nova era na computação e na inteligência artificial (IA) generativa. Com recursos revolucionários no mercado tecnológico, o Blackwell está destinado a desempenhar um papel fundamental em uma ampla gama de setores, desde processamento de dados e automação até computação quântica.

A IA generativa é a tecnologia definidora do nosso tempo. Blackwell é o motor para impulsionar essa nova revolução industrial. Trabalhando com as empresas mais dinâmicas do mundo, realizaremos a promessa da IA para cada setor.

Jensen Huang, fundador e CEO da NVIDIA.

Com parâmetros que garantem até 25 vezes menos custo de operação e consumo de energia do que seu antecessor, o Blackwell apresenta novas tecnologias revolucionárias, permitindo treinamentos de IA em modelos LLM (como ChatGPT) para escalas de até 10 trilhões de parâmetros diferentes, aumentando consideravelmente a capacidade de interpretação de dados e fornecimento de respostas e soluções inteligentes.

Em primeiro lugar, se destaca pela própria empresa como “o chip mais poderoso do mundo”. Com incríveis 208 bilhões de transistores, as GPUs Blackwell são produzidas utilizando um processo TSMC personalizado de 4NP, estabelecendo um novo padrão de potência e eficiência. A arquitetura emprega uma abordagem única com dois retículos por chip GPU, interconectados por uma ligação chip-a-chip de 10 TB/segundo, resultando em um único GPU unificado com capacidades de processamento sem precedentes.

Impulsionado pelo novo suporte de escalonamento de micro-tensor e pelos algoritmos avançados de gerenciamento de faixa dinâmica, permitirá que a arquitetura Blackwell dobre o poder de computação e os tamanhos de modelo, oferecendo novas capacidades de inferência de IA com pontos flutuante (floating points) de 4 bits.

O NVLink de 5ª Geração é outra tecnologia crucial, fornecendo um throughput bidirecional inovador de 1,8 TB/s por GPU. Isso possibilita a comunicação de alta velocidade entre até 576 GPUs, acelerando o desempenho de modelos de IA complexos com múltiplos trilhões de parâmetros e mistura de especialistas.

Além disso, as GPUs Blackwell incluem o Motor RAS (Reliability, Availability e Serviceability, em inglês), com um motor dedicado para garantir confiabilidade, disponibilidade e capacidade de serviço. A arquitetura também utiliza manutenção preventiva baseada em IA para diagnosticar e prever problemas de confiabilidade, maximizando o tempo de atividade do sistema e reduzindo os custos operacionais em implantações de IA em grande escala.

A segurança é uma prioridade e nas novas arquiteturas Blackwell será fornecida capacidades avançadas de computação confidencial. Isso protege modelos de IA e dados do cliente sem comprometer o desempenho, com suporte para novos protocolos de criptografia de interface nativa, especialmente importantes para indústrias sensíveis à privacidade, como saúde e serviços financeiros.

Por fim, o motor de descompressão dedicado acelera as consultas de banco de dados para proporcionar o mais alto desempenho em análise de dados e ciência de dados. Essa funcionalidade é crucial, considerando o crescente volume de dados e a demanda por análises rápidas e eficientes.

Em conjunto, essas novas tecnologias posicionam a arquitetura Blackwell como uma líder indiscutível em potência, eficiência e segurança para aplicações de IA, HPC e análise de dados no futuro do mercado de processamento.

Os produtos derivados da tecnologia Blackwell estarão prontos para o mercado por meio de parcerias estratégicas ainda este ano. Entre os pioneiros na oferta de serviços em nuvem impulsionados pela tecnologia Blackwell, se destacam os gigantes AWS, Google Cloud, Microsoft Azure e Oracle Cloud, além de participantes do programa de parceria em nuvem da NVIDIA, como Applied Digital, CoreWeave, Crusoe, IBM Cloud e Lambda. Além disso, plataformas de IA, como Indosat Ooredoo Hutchinson, Nebius, Nexgen Cloud e Oracle EU Sovereign Cloud, entre outras, também disponibilizarão serviços em nuvem e infraestrutura utilizando o Blackwell.

Além disso, a NVIDIA apresentou também um novo superchip que foi possibilitado graças a tecnologia Blackwell, o NVIDIA GB200 Grace Blackwell. Esse novo chip conecta duas GPUs NVIDIA B200 Tensor Core à CPU Grace da NVIDIA através de uma interconexão de chip para chip de ultra-baixa potência NVLink de 900GB/s. A plataforma atua como uma única GPU com 1,4 exaflops de desempenho de IA e 30TB de memória rápida, e é um bloco de construção para o mais novo DGX SuperPOD, que comentaremos sobre a seguir.

O novo GB200 fará parte do sistema NVIDIA GB200 NVL72 para cargas de trabalho de computação ainda mais intensivas. Ele combina 36 Superchips Grace Blackwell, que incluem 72 GPUs Blackwell e 36 CPUs Grace interconectadas por NVLink de quinta geração e promete oferecer até 30 vezes mais desempenho em comparação com o mesmo número de GPUs Tensor Core H100 da NVIDIA para cargas de trabalho de inferência LLM, e reduz custo e consumo de energia em até 25 vezes.

O supercomputador IA da próxima geração

Dentre os anúncios da NVIDIA ao redor da arquitetura Blackwell, foi apresentado o DGX SuperPOD, o próximo supercomputador da empresa com capacidade de computação geradora de IA na escala de trilhões de parâmetros. Alimentado por superchips Grace Blackwell GB200, o novo DGX SuperPOD é construído com sistemas NVIDIA DGXTM GB200 e fornece 11,5 exaflops de supercomputação de IA em precisão FP4 e 240 terabytes de memória, permitindo escalar para mais com racks adicionais.

O DGX SuperPOD é composto por oito ou mais sistemas DGX GB200, com a capacidade de expandir para dezenas de milhares de Superchips GB200 interligados através da tecnologia NVIDIA Quantum InfiniBand. Para criar um espaço de memória compartilhada considerável e suportar os modelos de IA de próxima geração, os clientes podem implementar uma configuração que conecta as 576 GPUs Blackwell presentes em oito sistemas DGX GB200 através do NVLink.

O novo DGX SuperPOD combina os últimos avanços em computação acelerada, redes e software da NVIDIA para permitir que cada empresa, indústria e país refine e gere sua própria IA.

Jensen Huang, fundador e CEO da NVIDIA.

O novo DGX SuperPOD é um supercomputador de IA completo, projetado para escala de data center, que se integra perfeitamente com armazenamento de alta performance fornecido por parceiros certificados pela NVIDIA, para atender às exigências das cargas de trabalho de IA generativa. Cada unidade é montada, conectada e testada na fábrica, resultando em uma implantação rápida e eficiente nos centros de dados dos clientes.

Além disso, o supercomputador vem equipado com recursos avançados de gerenciamento preditivo, capazes de monitorar continuamente milhares de pontos de dados em hardware e software. Isso permite prever e corrigir possíveis fontes de tempo de inatividade e ineficiência, resultando em economia de tempo, energia e custos computacionais.

O software integrado é capaz de detectar possíveis preocupações em um sistema, planejar manutenções, ajustar recursos computacionais de forma flexível e até mesmo salvar e retomar automaticamente tarefas para evitar qualquer interrupção, mesmo na ausência de administradores do sistema. Caso seja identificada a necessidade de substituição de algum componente, o cluster pode acionar sua capacidade de reserva para garantir que o trabalho em andamento seja concluído dentro do prazo.

Além do novo supercomputador, a NVIDIA também apresentou o DGX B200, uma plataforma unificada de supercomputação de IA, projetada para treinamento, ajuste fino e inferência de modelos. Ele apresenta o sistema DGX B200, que é a sexta geração de designs DGX montados em rack. O sistema inclui oito GPUs NVIDIA B200 Tensor Core e dois processadores Intel Xeon de 5ª geração.

Ele oferece desempenho de IA de até 144 petaflops, 1.4TB de memória GPU e 64TB/s de largura de banda de memória, proporcionando inferência em tempo real 15 vezes mais rápida para modelos de trilhões de parâmetros em comparação com a geração anterior. Os sistemas DGX B200 também possuem recursos avançados de rede, incluindo NICs NVIDIA ConnectXTM-7 e DPUs BlueField-3, fornecendo até 400 gigabits por segundo de largura de banda por conexão, garantindo desempenho rápido de IA com plataformas de rede NVIDIA Quantum-2 InfiniBand e NVIDIA SpectrumTM-X Ethernet.

O NVIDIA DGX SuperPOD com DGX GB200 e sistemas DGX B200 estará disponível ainda em 2024 para os parceiros globais da NVIDIA.

X800 series, os novos Switches de rede da NVIDIA

A NVIDIA também anunciou hoje os novos X800, a série de Switches da empresa feitos para processamento por IA em larga escala. A série Quantum-X800 InfiniBand e Spectrum-X800 Ethernet são os primeiros do mundo capazes de uma taxa de transferência de ponta a ponta de 800Gb/s, elevando os limites do desempenho de rede para cargas de trabalho de computação e IA.

Esses switches apresentam software avançado que impulsiona ainda mais aplicações de IA, computação em nuvem, processamento de dados e HPC (High-Performance Computing) em todos os tipos de data centers. Eles são especialmente projetados para se integrarem perfeitamente com a recém-lançada linha de produtos baseados na arquitetura Blackwell da NVIDIA, garantindo um desempenho excepcional em todos os aspectos.

Entre os primeiros a adotarem essas inovações estão gigantes da computação em nuvem como Microsoft Azure e Oracle Cloud, destacando a relevância e o impacto dessa tecnologia no avanço da IA em escala global. Além disso, a Coreweave, empresa líder em infraestrutura de computação em nuvem, também está entre os primeiros a adotar essas inovações, mostrando a rápida aceitação e a relevância desses avanços no setor.

Essa nova série de switches estabelece um novo padrão em infraestrutura dedicada à IA, oferecendo o mais alto desempenho e recursos avançados para atender às demandas cada vez maiores de aplicações de IA em nuvem e em empresas. Com promessas de melhorias significativas na velocidade de processamento, análise e execução de cargas de trabalho de IA, essa tecnologia promete acelerar o desenvolvimento e a implementação de soluções de IA em todo o mundo.

NVIDIA anuncia simulador climático por IA

A NVIDIA anunciou também hoje, durante a GTC 2024, o lançamento de seu mais recente simulador de clima, Earth-2, marcando um avanço no campo da modelagem climática. Desenvolvido com tecnologia de inteligência artificial de ponta, o Earth-2 oferece uma plataforma em nuvem para simulação e visualização do clima global em uma escala sem precedentes.

Uma das características mais impressionantes do Earth-2 é o uso de APIs que empregam modelos de IA avançados, incluindo o revolucionário modelo CorrDiff, que gera imagens com resolução 12,5 vezes maior do que os modelos numéricos atuais, em uma fração do tempo e consumo de energia. Essa capacidade de gerar simulações de alta resolução com rapidez e eficiência energética sem precedentes é uma conquista notável no campo da modelagem climática.

Além disso, o Earth-2 utiliza a Nuvem DGX da NVIDIA para fornecer aceleração total para soluções climáticas e meteorológicas, incluindo pipelines de IA otimizados e aceleração de GPU para modelos de previsão numérica do tempo. Isso significa que os usuários do Earth-2 têm acesso a uma vasta gama de ferramentas e recursos para criar simulações precisas e detalhadas do clima em diferentes escalas, desde a atmosfera global até eventos meteorológicos locais específicos, como tufões e turbulências.

Empresas como The Weather Company estão explorando maneiras de integrar os dados meteorológicos do Earth-2 com suas ferramentas de visualização, permitindo que os clientes compreendam melhor o impacto das condições meteorológicas reais em suas operações e planejamento. Outras empresas, como Spire e Meteomatics, estão aproveitando os recursos do Earth-2 para melhorar a precisão de suas previsões meteorológicas e oferecer insights mais precisos aos clientes.

Em última análise, o Earth-2 representa um passo em direção a uma compreensão mais profunda e precisa do clima global e dos eventos meteorológicos extremos. Com sua tecnologia de ponta e ampla gama de aplicações potenciais, este novo simulador tem o potencial de mudar a forma como entendemos e nos preparamos para os desafios climáticos do século XXI.

Disponibilidade de APIs do Omniverse Cloud

Na GTC 2024, a NVIDIA anunciou a disponibilidade de APIs do Omniverse Cloud que poderão ser utilizadas por devs e empresas, proporcionando uma maior integração com os principais softwares de design e automação do mercado.

Com o Omniverse Cloud APIs, desenvolvedores podem agora integrar facilmente as tecnologias centrais do Omniverse diretamente em aplicativos de software existentes, potencializando a criação, simulação e operação de gêmeos digitais baseados em física. Essa novidade representa um marco significativo na capacidade das empresas de projetar, testar e validar produtos e processos virtualmente, antes mesmo de serem construídos no mundo físico.

As cinco novas APIs do Omniverse Cloud, que podem ser usadas individualmente ou coletivamente, incluem:

- USD Render – gera renders totalmente ray-traced RTXTM de dados OpenUSD.

- USD Write – permite que os usuários modifiquem e interajam com dados OpenUSD.

- USD Query – permite consultas e cenários interativos.

- USD Notify – rastreia alterações do USD e fornece atualizações.

- Omniverse Channel – conecta usuários, ferramentas e mundos para permitir colaboração em cenas.

Grandes nomes da indústria já estão adotando as APIs do Omniverse Cloud em seus portfólios de software. Por exemplo, empresas como Siemens, Ansys, Cadence, Dassault Systèmes, entre outras, estão integrando as tecnologias do Omniverse para oferecer aos clientes uma experiência ainda mais imersiva e funcional.

Esses avanços não apenas prometem revolucionar a forma como as empresas projetam, constroem e operam produtos e processos industriais, mas também têm o potencial de impulsionar a competitividade, resiliência e sustentabilidade das empresas em todo o mundo.

Empresas adotam DRIVE Thor da NVIDIA no setor de transporte

Por último, a NVIDIA também comentou em sua apresentação na GTC 2024, sobre a adoção do DRIVE Thor pelo setor de transporte e diversas empresas.

O DRIVE Thor é muito mais do que um simples computador de carro, é uma peça fundamental na transformação do setor de transporte, impulsionando desde veículos de passageiros até caminhões de longa distância, robô-táxis e veículos de entrega autônomos. Com sua arquitetura, o Thor oferece não apenas capacidades avançadas de cockpit, mas também direção automatizada e autônoma segura, tudo em uma plataforma centralizada, utilizando processadores com a nova arquitetura Blackwell da NVIDIA, possibilitando processamentos com LLM e IAs generativas para tomadas de decisões.

Diversas empresas líderes no setor de veículos elétricos já adotaram o DRIVE Thor em seus projetos de próxima geração. A BYD, gigante global da indústria automotiva, está expandindo sua colaboração com a NVIDIA, incorporando o Thor em suas frotas de veículos elétricos. Além disso, a Hyper e a XPENG estão entre as empresas que escolheram o Thor para alimentar suas futuras frotas de veículos autônomos.

Além disso, o DRIVE Thor está ganhando destaque no setor de transporte de carga e logística. Empresas como Nuro, Plus, Waabi e WeRide estão liderando o caminho na adoção deste avançado sistema de IA para seus projetos de direção autônoma. Desde o desenvolvimento de tecnologias de direção para veículos comerciais e de consumo até a criação de soluções de caminhões autônomos em escala, estas empresas estão confiando no poder e na eficácia do DRIVE Thor para impulsionar a inovação em seus respectivos campos.

Com seu lançamento previsto para veículos de produção já no próximo ano, o DRIVE Thor promete revolucionar a indústria automotiva, com seu desempenho e sua capacidade de proporcionar uma condução autônoma confiável.

Fonte: NVIDIA.

Veja mais

Revisado por Glauco Vital em 18/3/24.